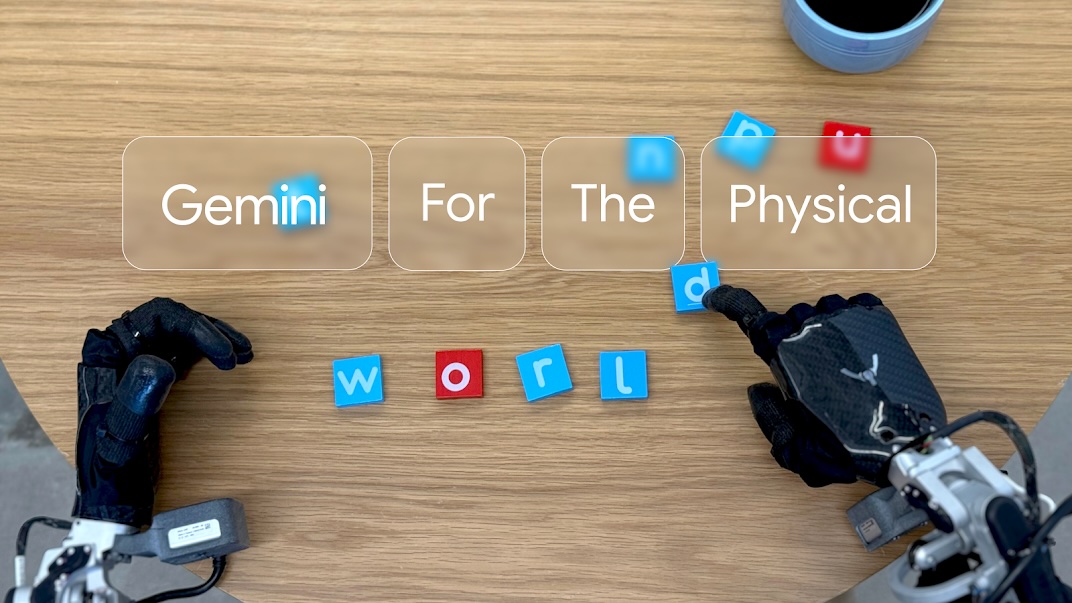

La inteligencia artificial y la robótica han dado un paso revolucionario con el reciente experimento de Google, que ha integrado su modelo de IA más potente, Gemini 2.0, en robots físicos. Gracias a esta conexión, las máquinas han logrado interpretar órdenes de lenguaje natural y ejecutar tareas manuales complejas sin necesidad de instrucciones detalladas.

En un video de demostración, se puede ver cómo los robots responden a comandos como «haz origami» o «dobla estos lentes», demostrando una capacidad de comprensión e interacción que hasta hace poco parecía ciencia ficción.

Un salto hacia la robótica universal

Hasta ahora, los robots han sido diseñados para tareas específicas, como ensamblaje en fábricas o aspirado en el hogar. Sin embargo, la integración de IA avanzada abre la puerta a una nueva generación de robots universales, capaces de aprender y adaptarse a distintos escenarios sin necesidad de ser reprogramados para cada acción.

Google no está solo en esta carrera. OpenAI, la empresa detrás de ChatGPT, reinició su unidad de software de robótica el año pasado, aunque hasta ahora no ha presentado avances concretos. Sin embargo, el interés de gigantes tecnológicos en este campo indica que la competencia por desarrollar robots verdaderamente inteligentes se está intensificando.

¿Cuándo veremos robots con IA en nuestra vida diaria?

El desarrollo de esta tecnología aún tiene desafíos, especialmente en coordinación motora y seguridad, pero los avances recientes sugieren que la integración de robots con IA en la vida cotidiana podría estar más cerca de lo que imaginamos.

Lo que está claro es que la fusión entre inteligencia artificial y robótica está en marcha, y en los próximos años podríamos ver robots que no solo sigan órdenes, sino que aprendan, razonen y actúen con autonomía.